Digital Strategy Review | 2026

联邦 AI 采购转向:特朗普政府要求机构停用 Anthropic 模型 | 果叔AI日报

文 / 果叔 · 阅读时间 / 8 Min

写在前面

过去 48 小时,AI 圈最值得放在头版的消息,已经从“模型能力竞赛”切到了“国家级采购与治理分配”。

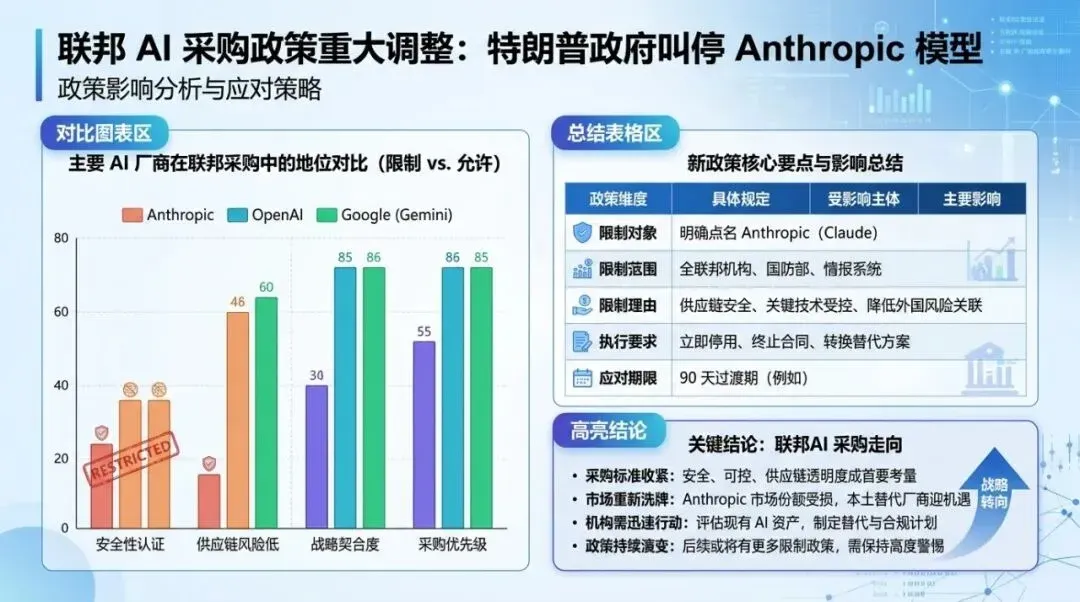

3 月 3 日(美国时间),多家媒体集中报道:特朗普政府要求联邦机构逐步停用 Anthropic 模型,并把关键合同迁移到 OpenAI 体系。这个动作的真正含义,不在于谁赢了一单合同,而在于“谁可以定义公共部门 AI 的边界条件”。

对做产品和做增长的团队来说,这件事会直接影响三条线:合规要求怎么定、企业采购怎么选、以及你在政府和大型企业招标里需要交付什么样的可控性证据。

01

今日头版重点新闻

事件脉络(按时间线)

3 月 2 日,Anthropic 发布《National Security and American Leadership》,公开其“支持国家安全合作,但坚持保留红线”的立场,文中强调其模型会用于防御、情报分析、网络安全等场景,同时要维持对高风险用法的安全限制。

同一天,OpenAI 发布《OpenAI’s DoD Partnership: Policy Update》和《OpenAI’s U.S. Defense Department Contract: FAQ》,明确其与美国国防部合作的边界,并重申“禁止用于大规模监控与自主致命武器”的政策条款。

到了 3 月 3 日,路透、英国《金融时报》与《华盛顿邮报》等媒体陆续报道,白宫层面要求联邦机构推进对 Anthropic 的停用与迁移安排。部分报道提到,迁移执行窗口可能以 4 月 30 日为节点完成首轮切换。

关键事实拆解

01 这次变化发生在“联邦级采购层”,影响对象是预算、合同、合规与责任链条,不是某个单部门的测试项目。

02 争议焦点集中在“是否接受军方无限制访问”与“谁来设定安全红线”。

03 OpenAI 一侧同步释放了政策说明,传递的信息很清晰:合作可以扩大,但必须把政策约束写进合同和执行机制。

为什么它是今天头版

这条新闻的影响半径已经超过“AI 公司公关战”。它会改写公共部门对大模型的评估框架:从“模型性能强不强”升级到“模型治理可不可信、责任可不可追、供应是否可替换”。

更直白一点说,联邦采购体系在用真金白银告诉市场,下一阶段的胜负手是“可治理能力”。

02

头版解读:为什么这件事更重要

1. 商业层:联邦采购正在重定 SaaS AI 的门槛

过去一年很多团队默认的逻辑是:模型效果领先,就能拿下更多 B 端场景。现在这个逻辑明显不够了。联邦机构与大型 regulated 企业会把评估标准前移到三件事:

• 你能否提供可验证的安全策略与违例处理机制;

• 你是否支持细粒度审计(谁调用、何时调用、调用结果如何);

• 当政策变化时,你的系统能否在 30-90 天内完成迁移或降级运行。

这意味着行业竞争会出现一次“估值逻辑换挡”:纯模型能力的溢价会被压缩,平台化交付、合规能力、政府关系与生态稳定性会被重新定价。

2. 政策层:AI 治理进入“合同化执行”阶段

很多人把 AI 治理理解成原则声明。更准确的说法是,治理真正生效的地方在合同条款、采购流程、验收口径与审计周期。

从 3 月 2 日到 3 月 3 日的连续动作看,华盛顿给出的方向很明确:

• 高风险场景要有白纸黑字的边界;

• 供应商必须接受持续审计;

• 出现政策冲突时,政府会优先保障可控性和可替代性。

这套逻辑很可能外溢到金融、医疗、能源等关键行业。未来大客户问你的第一句可能不是“推理速度多少”,而是“你如何保证我们在监管变化时不掉线”。

3. 技术层:模型公司将被迫强化“可操作治理”

今天多数团队谈“安全”仍然停在 policy 文档。下一阶段要落地到工程:

• 任务级别权限与拒绝策略(按角色、按场景、按风险动态执行);

• 审计日志默认开启且可导出;

• 敏感场景双轨机制(模型建议 + 人工复核 + 可追责签名链路);

• 紧急切换能力(供应商替换时保证业务连续)。

如果这些能力做不出来,你就很难进入政府与超大型企业的核心系统。

4. 生态层:多模型并存会成为新常态

这次事件还释放了一个实操信号:单一模型绑定的架构风险被显性化了。越来越多企业会建设“多模型路由 + 统一安全层 + 统一观测层”的架构,目标是把政策风险和供应风险分散。

从产业角度看,这会催生一轮新的中间层市场:模型网关、策略编排、审计平台、合规模板服务。

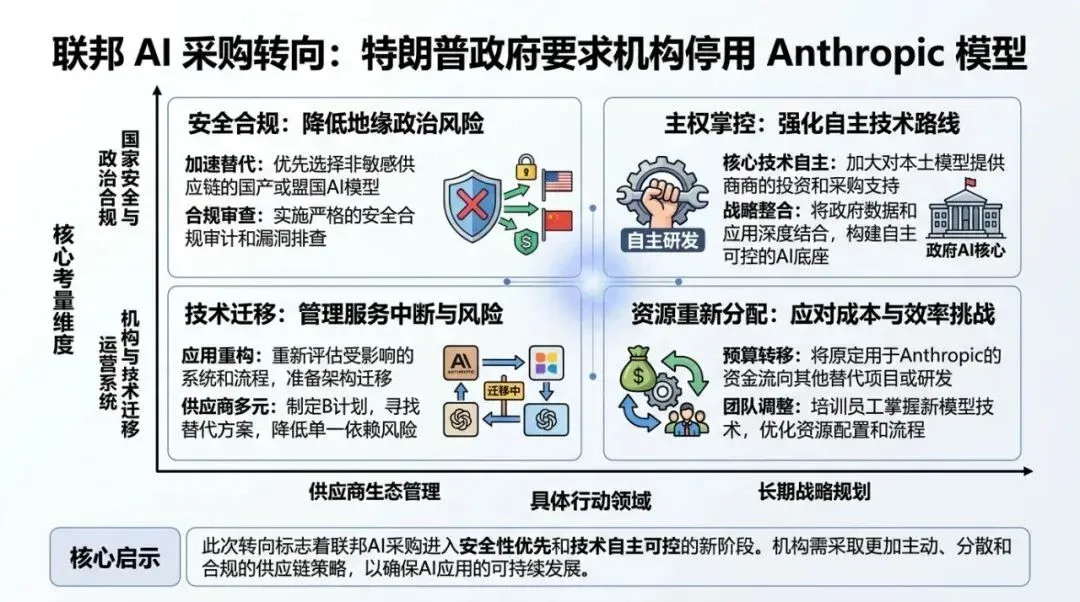

流程图用于解释方法论执行路径。

03

果叔观点

我给做 AI 产品的团队一个非常务实的判断:2026 年的企业级竞争,核心题目已经从“做一个更聪明的模型应用”变成“做一个可被审计、可被替换、可被托底的 AI 系统”。

我建议你本周就推进三件事

01 做一版“合规压力测试” 把你当前核心流程跑一遍:如果主模型 30 天内被监管限制,你能否在不改业务逻辑的前提下替换模型并保持 SLA?做不到就立刻补中间层。

01 把安全策略从文档改成策略引擎 把“禁止场景、降级条件、人工复核阈值”写成机器可执行规则,让它在调用时自动生效,而不是靠人工记忆。

01 给销售与客户成功团队补一套“可治理话术” 现在客户真正关心的,是你如何在政策波动里保证稳定服务。把审计能力、回滚能力、迁移能力讲清楚,成交效率会明显提升。

未来 90 天最值得盯的三个指标

• 联邦采购侧是否形成更明确的 AI 合规模板;

• 头部模型厂商是否公开更细粒度的 defense/公共部门策略;

• 大型企业 RFP 是否把“可替换架构”列为硬性条款。

如果这三个指标同时强化,AI 工程的主战场会正式进入“治理工程化”周期。

用数据图解释关键对比和结论。

04

其他重点新闻速览

Google 与 SerpAPI 诉讼进入程序攻防阶段

围绕搜索抓取、数据使用与服务边界的争议继续升级。对 SEO 与数据产品公司来说,这类案件会持续影响 API 生态与采集合规成本。

来源:https://serpapi.com/blog/google-v-serpapi-motion-to-dismiss-why-were-in-the-right/

AI 正确性问题在高价值任务中暴露得更明显

John D. Cook 的案例讨论了模型在专业金融语境中的“看起来合理、细节却错位”的风险,这对自动化投研和财务 Copilot 的上线节奏是直接提醒。

来源:https://www.johndcook.com/blog/2026/03/02/an-ai-odyssey-part-1-correctness-conundrum/

LLM 人格工程开始从提示词技巧走向流程化方法

开发者社区正在把“人格设计”从灵感式写法转成结构化模板,这会让客服、销售和教育场景中的代理一致性更高,也更容易做 A/B 评估。

来源:https://seangoedecke.com/giving-llms-a-personality/

AI 内容质量争议继续放大,平台侧治理压力上升

“AI slop”讨论从创作者社区扩散到分发平台和品牌侧,接下来会看到更多平台在推荐策略里提高来源可信度与原创信号权重。

来源:https://pluralistic.net/2026/03/02/nonconsensual-slopping/

AI 供应链中的传递性信任问题被重新审视

工程社区开始强调依赖链、构建链和包管理命名策略的系统性风险。对 AI 应用团队来说,这会推动 SBOM、签名验证、最小权限部署成为默认实践。

来源:https://nesbitt.io/2026/03/02/transitive-trust.html

矩阵图用于说明适用边界和策略选择。

05

趋势与机会

1) 机会:面向“可治理 AI”的基础设施将迎来增量

模型路由、策略引擎、审计与留痕、风险分级执行,这些原本属于“大客户定制”的能力,会快速产品化。谁先把它做成标准化组件,谁就能拿到 2026 年企业预算里的新增份额。

2) 机会:合规叙事会变成销售主战场

今天很多团队的市场叙事还停留在“更快更强”。接下来更有效的叙事是“在不确定政策环境里提供确定交付”。这会直接影响签单周期和续约率。

3) 风险:单模型绑定会成为经营风险

如果你把核心流程绑在单一模型与单一供应链上,政策、合同、价格任一维度波动都可能打穿成本结构。多模型架构与策略抽象层应当尽快补齐。

4) 风险:只做功能不做审计,会在关键客户前失分

大客户现在要的是“能上线、能解释、能追责”。只展示 demo 效果,越来越难通过采购与风控审查。